Fake mit KI oder Wirklichkeit

Fake mit KI oder Wirklichkeit

GStCx3G4_EM

Quiz: KI-Fake oder Wirklichkeit

KI-Fake oder Wirklichkeit (KI-Fake) (!Wirklichkeit)

Einleitung

Dieser aiMOOC führt Dich in das Thema Fake mit KI oder Wirklichkeit ein. Du lernst, wie KI-gestützte Systeme Texte, Bilder, Videos und sogar Songs erzeugen – und wie Du sie von echten Inhalten unterscheiden kannst. Wir betrachten die technischen Grundlagen (z.B. Große Sprachmodelle, Diffusionsmodelle, GANs), typische Erkennungsmerkmale (Artefakte, Prompt-Spuren, Metadaten), Tools für die Verifikation (z.B. Rückwärtssuche), rechtliche Aspekte (Urheberrecht, Persönlichkeitsrechte) und ethische Fragen (Desinformation, Bias, Verantwortlichkeit). Mit interaktiven Aufgaben, Quiz und offenen Projekten kannst Du Dein Wissen anwenden – in Schule, Ausbildung oder Studium.

Grundlagen: Was kann KI heute generieren?

- KI-Texte: Chatbots auf Basis Großer Sprachmodelle erzeugen zusammenhängende Texte, imitieren Stile und beantworten Fragen.

- KI-Bilder: Diffusionsmodelle und andere Bildgeneratoren erstellen fotorealistische oder stilisierte Motive aus Text-Prompts.

- KI-Videos: Face-Swaps, Lippensynchronisation, Video-Interpolation – real wirkende Clips entstehen aus Bild- und Audiomaterial.

- KI-Songs: Systeme komponieren Melodien, erzeugen Gesangsstimmen und mischen Stile bekannter Künstlerinnen und Künstler.

Chancen und Risiken

- Chancen: Kreativität, Prototyping, Barrierefreiheit (z.B. Untertitel, Audiodeskription), Bildung, Forschung.

- Risiken: Desinformation, Rufschädigung, Urheberrechtsverletzungen, Deepfake-Betrug (z.B. CEO-Fraud), Vorurteile in Trainingsdaten.

Technische Bausteine in Kürze

- Große Sprachmodelle (LLMs): Wahrscheinlichkeitsmodelle für Wortfolgen (Tokenizer, Attention, Transformer).

- Bildgeneratoren: Diffusion (Rauschen → Bild), GANs (Generator vs. Diskriminator).

- Audio/Musik : Spektrogramme, TTS, Stimmenklonen.

- Video : Frame-für-Frame-Generierung, Face-Tracking, Lippensynchronität.

Typische Erkennungsmerkmale (Heuristiken)

- Texte: Übermäßige Allgemeinplätze, fehlende Quellen, gleichförmiger Ton, Halluzinationen, fehlerhafte Zitate.

- Bilder: Unstimmige Hände/Ohren, seltsame Spiegelungen, unnatürliche Hintergründe, Textartefakte in Schildern.

- Videos: Unnatürliche Blinzelsequenzen, unpassende Schatten, Lippen-/Ton-Asynchronität.

- Songs: Künstlich wirkende Atemgeräusche, unnatürliche Artikulation, Stilkopie ohne charakteristische Nuancen.

Verifikation: Praktische Checkliste

- Quelle prüfen: Impressum, Autorenprofil, Veröffentlichungsdatum.

- Kontext prüfen: Wo zuerst erschienen? Passt der Inhalt zur Quelle?

- Rückwärtssuche: Google Bilder, TinEye, Yandex – Originale finden.

- Metadaten: EXIF/Datei-Infos (oft entfernt).

- Cross-Check: Weitere seriöse Medien? Offizielle Statements?

- Techniktests: KI-Detektoren mit Vorsicht nutzen – nie allein entscheiden lassen.

- Gesunder Zweifel: „Zu gut/zu empörend, um wahr zu sein?“

Recht & Ethik im Überblick (keine Rechtsberatung)

- Urheberrecht: Trainingsdaten, Stilimitate, Zitatrecht, Lizenzen.

- Persönlichkeitsrechte: Recht am eigenen Bild/Stimme, Einwilligung.

- Kennzeichnung: Transparenzpflichten in Institutionen/Medien.

- Schule & Wissenschaft: Eigenleistung, Zitation, Plagiat, Prüfungsordnungen.

- Verantwortung: Fairness, Datenschutz, Schutz marginalisierter Gruppen.

KI-Texte erkennen

- Leseprobe laut vorlesen – klingt es „glatt“ und austauschbar?

- Prüfe Fakten und Zitate (mit Quellen!).

- Suche nach ungewöhnlich gleicher Struktur in Abschnitten.

- Variiere eine Nachfrage – reagiert der Autor konsistent?

- Nutze Plagiats- und Stil-Tools, aber nie als alleinige Instanz.

KI-Bilder erkennen

- Zoome auf Hände, Ohren, Zähne, Text auf Schildern.

- Achte auf Licht-/Schattenkonsistenz.

- Prüfe Hintergründe auf „Schlieren“ oder Duplikate.

- Starte eine Rückwärtssuche.

- Prüfe die Bildquelle (Agentur, Fotograf, Lizenz).

KI-Videos (Deepfakes) erkennen

- Unnatürliche Mimik, „Gummigesicht“-Effekt, Hals-/Ohrenränder.

- Tonspur separat anhören: Schnitte, Artefakte, Atmer.

- Kontextcheck: Hat die Person das Ereignis tatsächlich besucht?

- Prüfe Upload-Historie des Accounts.

KI-Songs erkennen

- Auffällig konstante Stimmfarbe ohne Mikrofon-/Raumvariation.

- Unnatürlich perfekte Intonation, fehlende Fehltritte.

- Rechteklärung: Ist ein offizieller Release vorhanden?

Gute Praxis beim Erstellen: Fair & transparent

- Kennzeichne KI-Einsatz offen (z.B. „Text mit KI assistiert“).

- Nutze lizenzierte Prompts/Modelle.

- Respektiere Persönlichkeits- und Urheberrechte.

- Bewahre Rohdateien und Versionen zur Dokumentation.

Interaktive Aufgaben

Quiz: Teste Dein Wissen

Welches Verfahren steht typischerweise hinter fotorealistischer KI-Bilderzeugung? (Diffusionsmodell) (!K-Means-Clustering) (!Lineare Regression) (!Apriori-Algorithmus)

Was beschreibt ein Großes Sprachmodell LLM am treffendsten? (Ein Transformer-basiertes Wahrscheinlichkeitsmodell für Wortfolgen) (!Ein Bildklassifikator für Katzen) (!Eine Datenbank für Metadaten) (!Ein rein regelbasiertes Expertensystem)

Welches Merkmal ist KEIN typisches KI-Bild-Artefakt? (Konsistente Handanatomie mit fünf Fingern) (!Unstimmige Hände oder Zähne) (!Verschmierte Schrift auf Schildern) (!Unlogische Spiegelungen)

Welche Methode hilft bei der Bildverifikation besonders? (Rückwärtssuche in Bildersuchmaschinen) (!Erhöhung der Sättigung) (!Zuschneiden der Ränder) (!Speichern als GIF)

Wofür stehen die Buchstaben in GAN? (Generative Adversarial Network) (!General Artificial Node) (!Graph Attention Network) (!Generic Array Notation)

Welches Risiko ist typisch für Deepfakes? (Identitäts- und Rufschädigung durch gefälschte Aussagen) (!Verbessertes Raumklang-Erlebnis) (!Verkürzte Ladezeiten von Webseiten) (!Besserer Akkuverbrauch)

Was ist bei KI-Detektoren zu beachten? (Sie können irren und sollten nie allein über Echtheit entscheiden) (!Sie sind unfehlbar bei langen Texten) (!Sie funktionieren nur offline) (!Sie sind rechtlich verpflichtend)

Welches Anzeichen weist auf KI-generierte Songs hin? (Konstant künstliche Stimmfarbe ohne typische Mikrofonartefakte) (!Live-Publikum im Hintergrund) (!Analoge Bandrauschen-Artefakte) (!Unsaubere Intonation mit zufälligen Fehlern)

Welche Aussage zu Metadaten ist korrekt? (Metadaten können Hinweise zur Entstehung oder Bearbeitung liefern) (!Metadaten sind immer fälschungssicher) (!Metadaten existieren bei Bildern nicht) (!Metadaten sind gesetzlich verboten)

Welche gute Praxis fördert verantwortungsvollen KI-Einsatz? (Transparente Kennzeichnung von KI-Assistenz) (!Verstecken der Rohdateien) (!Vermeiden von Quellenangaben) (!Nutzung fremder Stimmen ohne Einwilligung)

Memory

Erstelle ein Memory mit passenden Paaren.

| LLM | Sprachmodell |

| Diffusion | Bildsynthese |

| GAN | Generator–Diskriminator |

| Deepfake | Gesichtsmanipulation |

| Rückwärtssuche | Bildverifikation |

| Metadaten | EXIF |

Drag and Drop

| Ordne die richtigen Begriffe zu. | Thema |

|---|---|

| Transformer | Architektur für Sprachmodelle |

| Diffusionsmodell | Rauschen-zu-Bild-Verfahren |

| GAN | Generator gegen Diskriminator |

| EXIF | Bild-Metadaten |

| Rückwärtssuche | Originalquelle finden |

...

Kreuzworträtsel

| transformer | Welche Architektur prägt heutige Sprachmodelle? |

| diffusion | Welches Verfahren erzeugt Bilder aus Rauschen? |

| exifdaten | Wie heißen häufige Bild-Metadaten? |

| deepfake | Wie nennt man manipulierte KI-Videos von Personen? |

| prompting | Wie heißt das Formulieren von Eingaben an Modelle? |

| verifikation | Wie nennt man den Prozess der Echtheitsprüfung? |

LearningApps

Lückentext

Offene Aufgaben

Leicht

- Begriffskarte KI-Fakes: Erstelle eine Mindmap zu Arten von KI-Fakes (Text, Bild, Video, Song) mit Beispielen.

- Checkliste Verifikation: Formuliere eine persönliche 7-Punkte-Checkliste zur Echtheitsprüfung.

- Prompt-Sammlung: Sammle fünf Prompts, mit denen man KI-Bildartefakte provozieren kann, und erläutere die Ergebnisse.

Standard

- Case Study Medienanalyse: Analysiere einen viralen Post und dokumentiere Deine Verifikationsschritte (Screenshots, Quellen).

- Stilvergleich Text: Schreibe einen Absatz selbst und lasse einen mit KI erzeugen; markiere Unterschiede und Gemeinsamkeiten.

- Audio-Forensik light: Vergleiche zwei kurze Gesangsschnipsel (echt vs. KI) und beschreibe hörbare Indizien.

Schwer

- Richtlinienentwurf: Entwickle Guidelines zur KI-Kennzeichnung für Eure Schule/Institution.

- Technik-Demo: Recherchiere und skizziere, wie ein Diffusionsmodell funktioniert (mit vereinfachter Grafik).

- Ethik-Debatte: Organisiere eine Debatte „Verbieten oder Regulieren?“ und fasse die Positionen strukturiert zusammen.

Lernkontrolle

- Transfer Medienkompetenz: Wende Deine Checkliste auf einen aktuellen Fall an und begründe Deine Entscheidung.

- Risikomatrix: Erstelle eine Matrix, die Auswirkungen (niedrig–hoch) vs. Wahrscheinlichkeit (selten–häufig) für KI-Fakes abbildet.

- Stakeholder-Analyse: Identifiziere Betroffene von Deepfakes (z.B. Politik, Unternehmen, Privatpersonen) und leite Schutzmaßnahmen ab.

- Vergleich der Modelle: Erkläre, warum Diffusionsmodelle für Bilder und Transformer für Texte besonders geeignet sind.

- Rechts- und Ethikfall: Beurteile einen hypothetischen Fall (ungefragtes Stimmenklonen eines Lehrers) aus rechtlicher und ethischer Perspektive.

OERs zum Thema

Medien

Links

Teilen - Diskussion - Bewerten

Schulfach+

aiMOOCs

aiMOOC Projekte

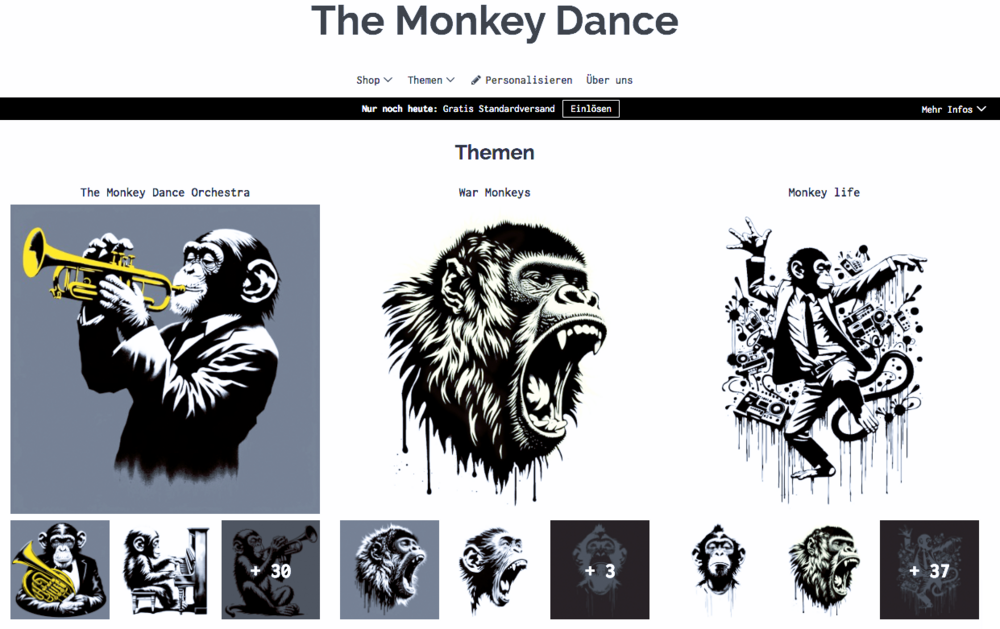

THE MONKEY DANCE

|

|

|

Sponsoren, Förderer, Kooperationspartner

Children for a better world >> Förderung der AI Fair-Image Challenge

Fair-Image wird von CHILDREN JUGEND HILFT! gefördert und ist mit der deutschlandweiten AI Fair-Image Challenge SIEGERPROJEKT 2025. Alle Infos zur Challenge hier >>. Infos zum Camp25 gibt es hier. Wenn auch Ihr Euch ehrenamtlich engagiert und noch finanzielle Unterstützung für Eurer Projekt braucht, dann stellt gerne einen Antrag bei JUGEND HILFT.